Tech Transparency Project přichází s dalším znepokojivým zjištěním. Po lednové zprávě, která upozornila na desítky aplikací (v App Store a Google Play), které zvládnou svléknout osobu, se nyní zaměřil na samotné vyhledávací a reklamní algoritmy Applu. Výsledek je zarážející. Samotný systém totiž uživatelům napomáhá tyto kontroverzní nástroje najít a některé z nich dokonce nabízí jako vhodné i pro mladistvé.

Mohlo by vás zajímat

Reklamy na svlékání na prvních místech

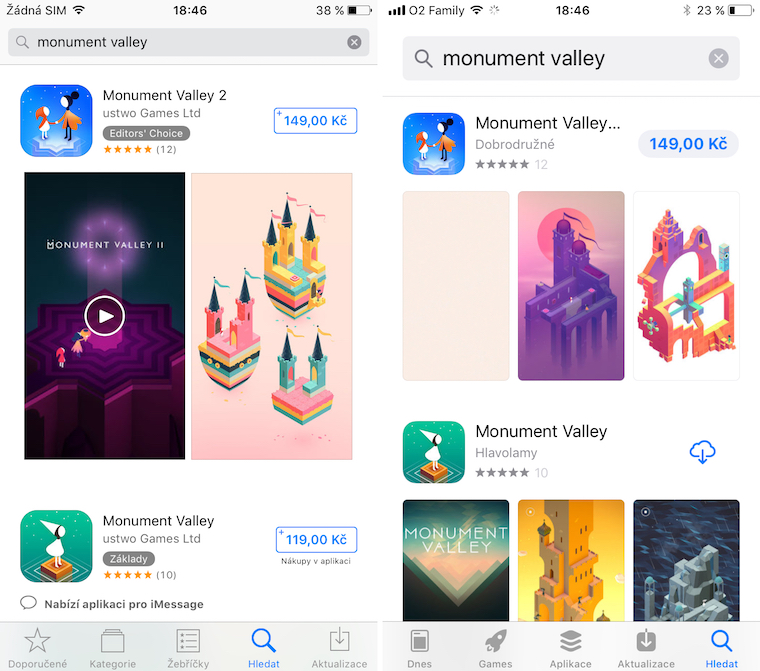

Zpráva uvádí, že téměř 40 % aplikací z prvních deseti výsledků po vyhledání hesel jako „nudify“ nebo „deepnude“ skutečně dokáže vygenerovat nahé nebo částečně odhalené ženy. Co je ale horší, vyhledávání obecnějších pojmů často vrací tyto nástroje jako sponzorované výsledky.

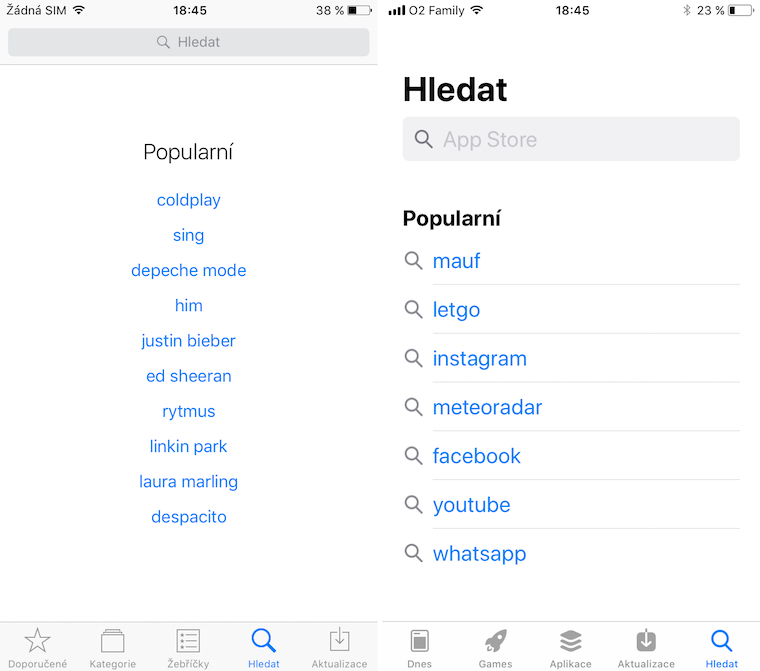

Při zadání hesla pro výměnu obličejů nebo „deepfake“ na vás vyskočí placená reklama na aplikace, které bez jakéhokoliv omezení či moderace nasadí obličej z běžné fotky na video cizí nahé postavy. Svůj podíl viny nese i samotný našeptávač. Když do vyhledávání zadáte jen „AI NS“, App Store vám ochotně nabídne dokončení na text plný NSFW obsahu, což vás opět dovede přímo ke generátorům pro dospělé.

Výmluvy na modely

Zajímavá je komunikace s některými vývojáři. Jeden z tvůrců, jehož aplikace k tvorbě obrázků využívala model Grok, se bránil tím, že prý vůbec netušil, jak extrémní obsah dokáže jeho nástroj vygenerovat. Slíbil však okamžité zpřísnění filtrace. Apple po obdržení zprávy většinu identifikovaných aplikací okamžitě smazal a k celé věci se odmítl blíže vyjádřit.

Mohlo by vás zajímat

Za mě je naprosto nepřijatelné, že se Apple neustále „ohání“ bezpečností a striktními pravidly schvalování, ale vesele bere peníze z reklam na aplikace, které slouží k tvorbě deepfake pornografie.