Apple představil Manzano, nový multimodální model, který zvládá porozumění obrazu i generování obrázků v rámci jedné architektury – a to bez zásadních kompromisů v kvalitě. Vědecká studie detailně popisuje, jak se Applu podařilo překonat technické problémy, které jiné modely doposud brzdily.

Mohlo by vás zajímat

Dnešní multimodální modely čelí zásadnímu problému: buď dobře rozumí obrazům, nebo umí generovat kvalitní vizuály – ale málokdy obojí zároveň. Důvodem je rozdílný přístup k vizuálním datům: porozumění potřebuje spojité (continuous) reprezentace, zatímco generování preferuje diskrétní (discrete) tokeny.

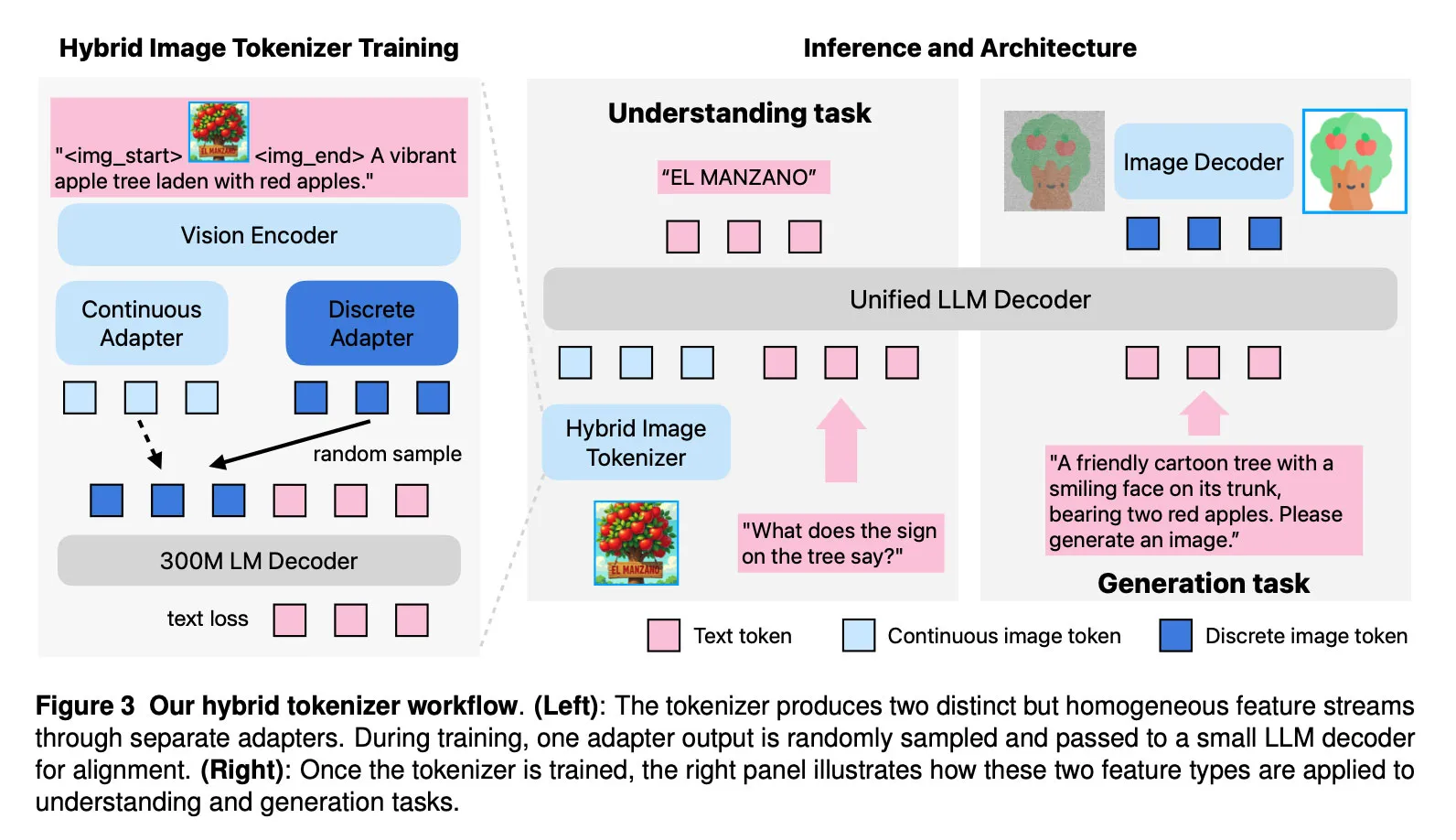

Manzano tento problém řeší pomocí hybridního vizuálního tokenizéru, který vytváří oba typy reprezentací zároveň. Model pak využívá autoregresivní LLM dekodér, který na základě textu a vizuálních vstupů předpovídá nové obrazové nebo textové tokeny. Nakonec obrazové tokeny zpracuje difuzní dekodér, který vytvoří samotný obraz.

Silný výkon a kreativní schopnosti

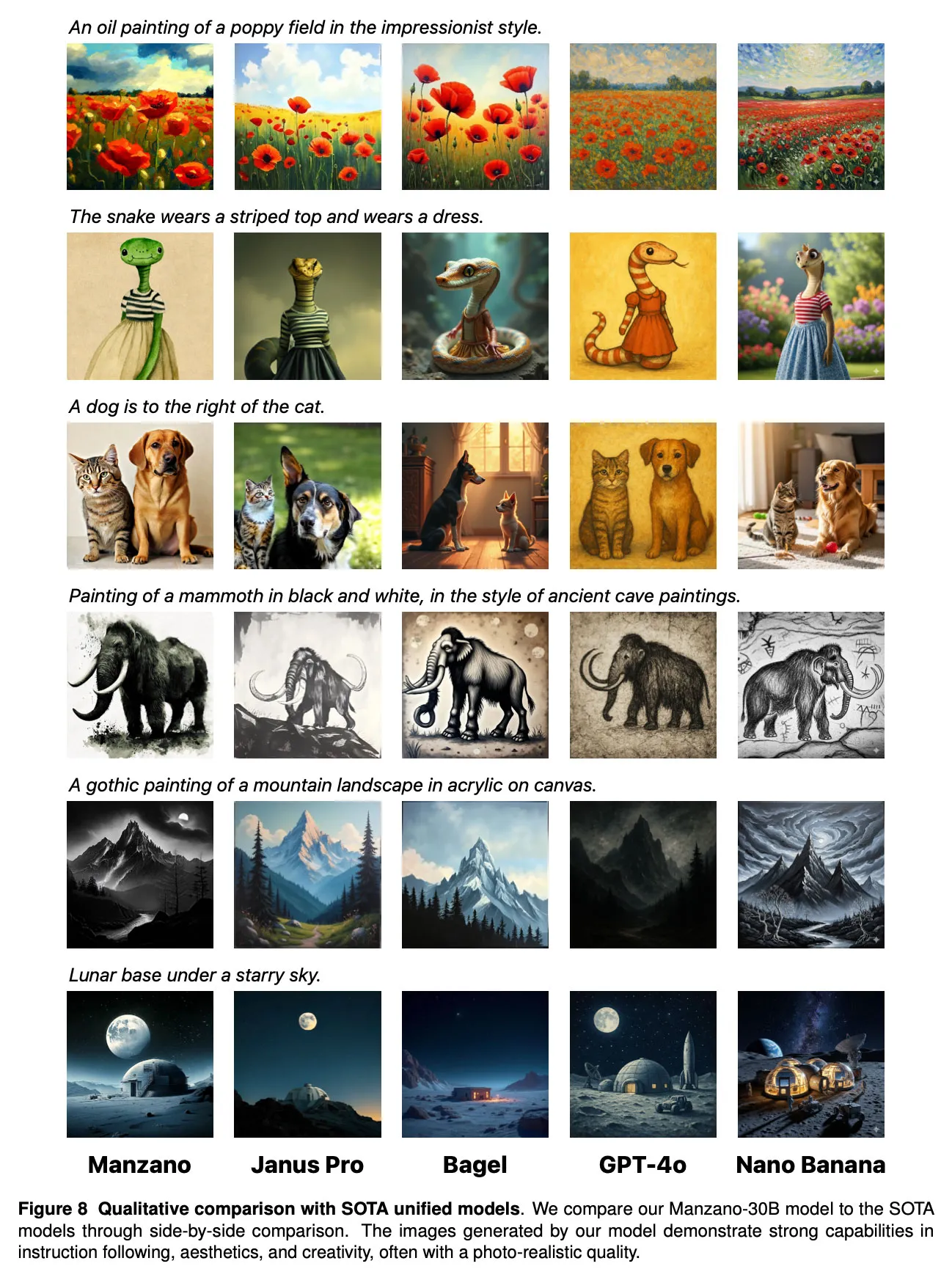

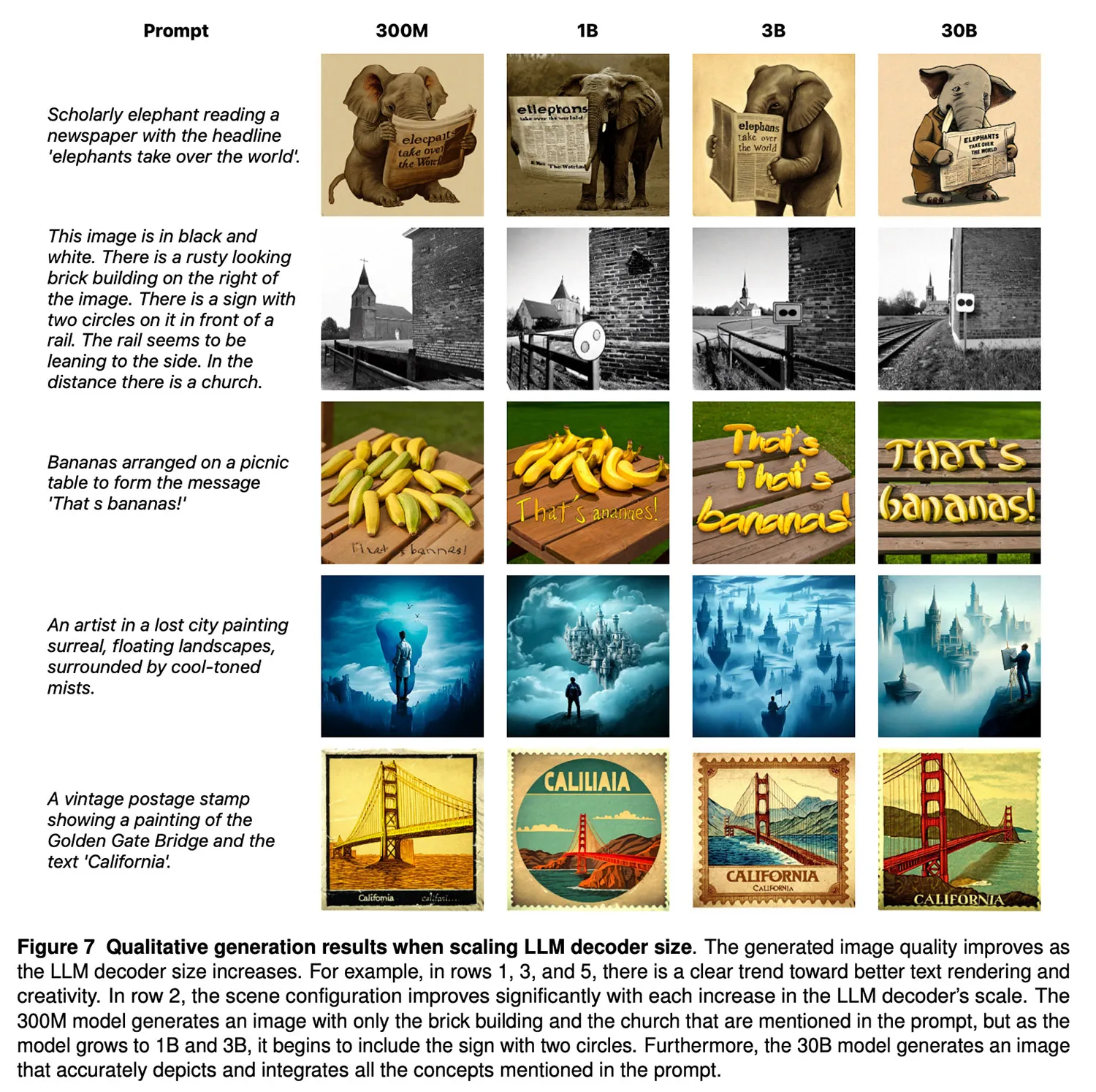

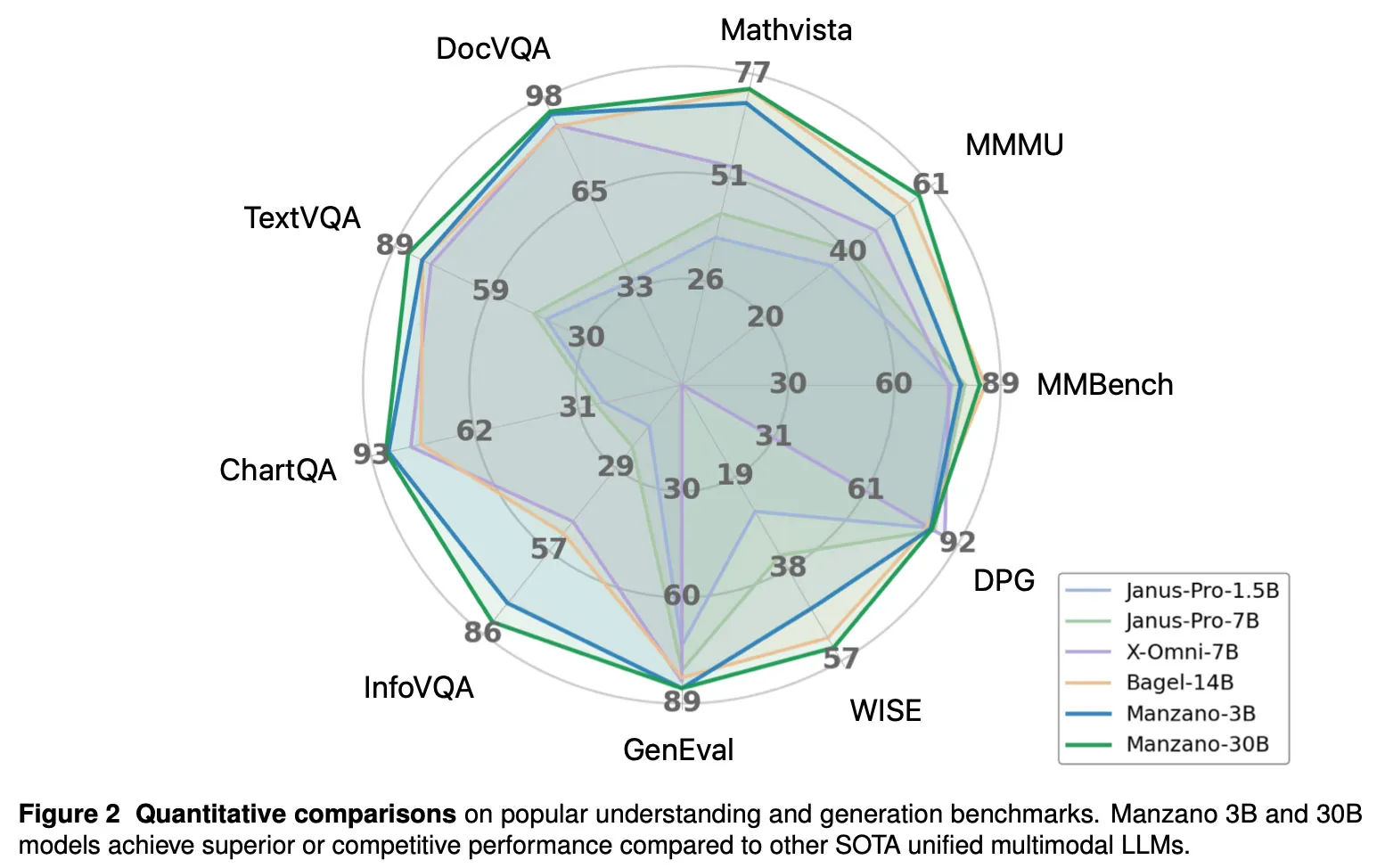

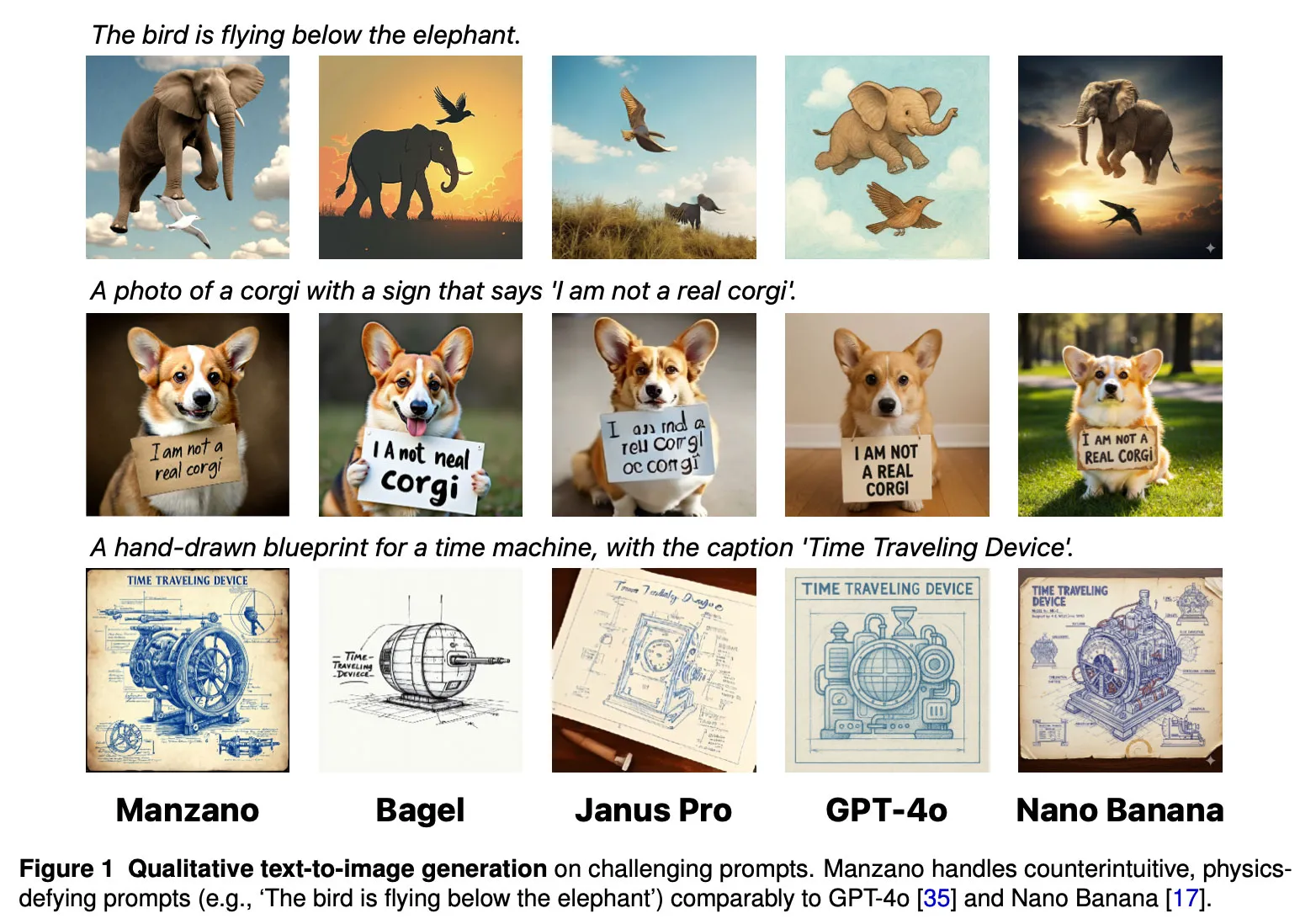

Apple tvrdí, že model Manzano (včetně verzí se 3B a 30B parametry) dosahuje srovnatelných nebo lepších výsledků než špičkové modely jako GPT-4o nebo Google Nano Banana. Zvládá i „fyzikálně nemožné“ podněty typu „pták letí pod slonem“.

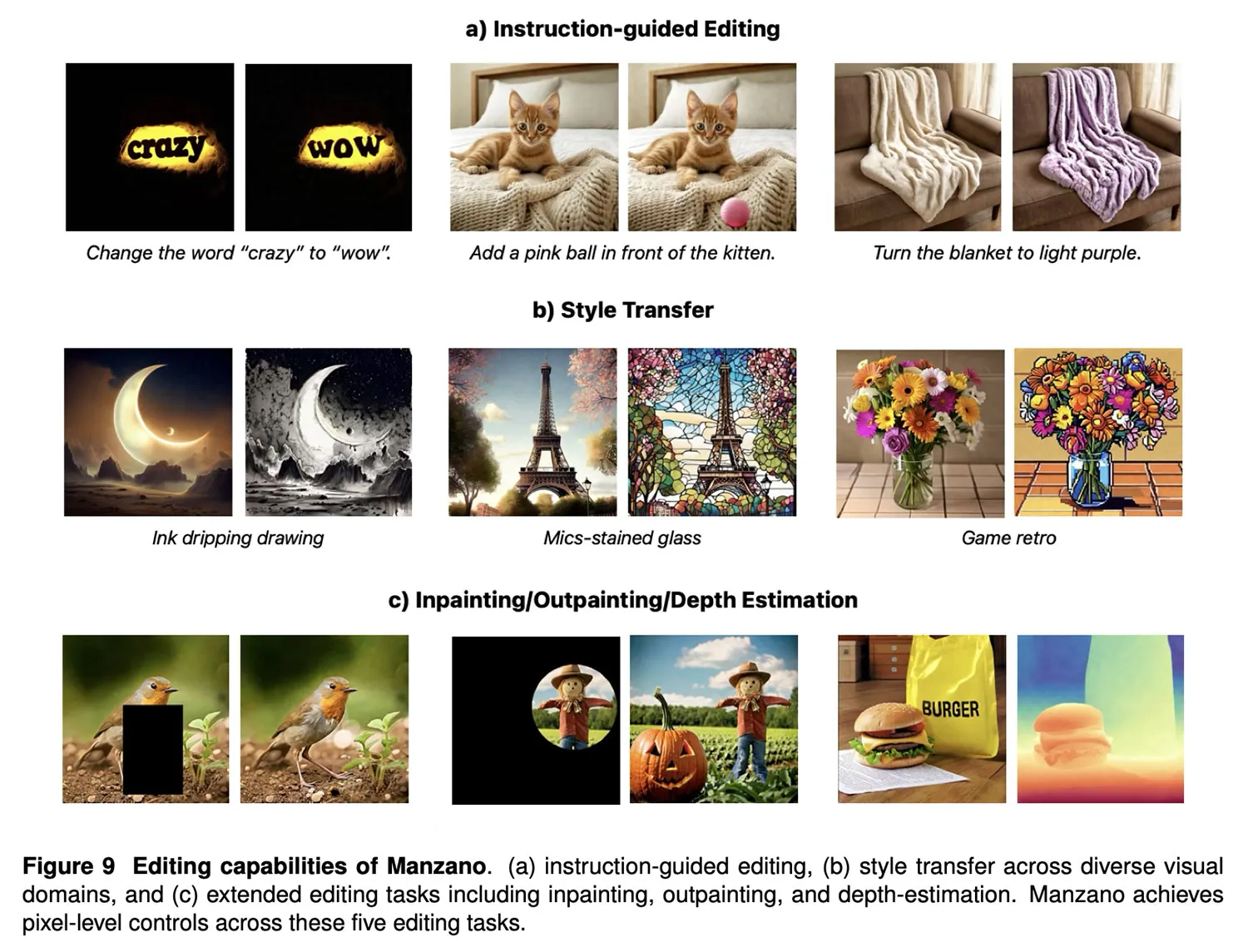

Kromě generování dokáže Manzano i editovat obrázky – zvládne stylizaci, inpainting, outpainting nebo odhad hloubky. Výkon modelu navíc škáluje dobře s rostoucím počtem parametrů, což potvrzují i výzkumné benchmarky. I když zatím není dostupný přímo na zařízeních Apple, vývoj Manzana a dalších projektů (např. UniGen) naznačuje, že Apple připravuje vlastní špičková řešení pro generování obrázků, která by mohla konkurovat současným lídrům na trhu.