Vědci z Applu ve spolupráci s University of Wisconsin–Madison představili nový framework RubiCap, který zásadně posouvá možnosti takzvaného „hustého popisování obrázků“. Na rozdíl od běžné AI, která obrázek shrne jednou větou, RubiCap dokáže identifikovat a detailně popsat jednotlivé objekty i prosředí Výsledkem je mnohem hlubší pochopení scény, což je klíčové pro trénování modelů text-to-image.

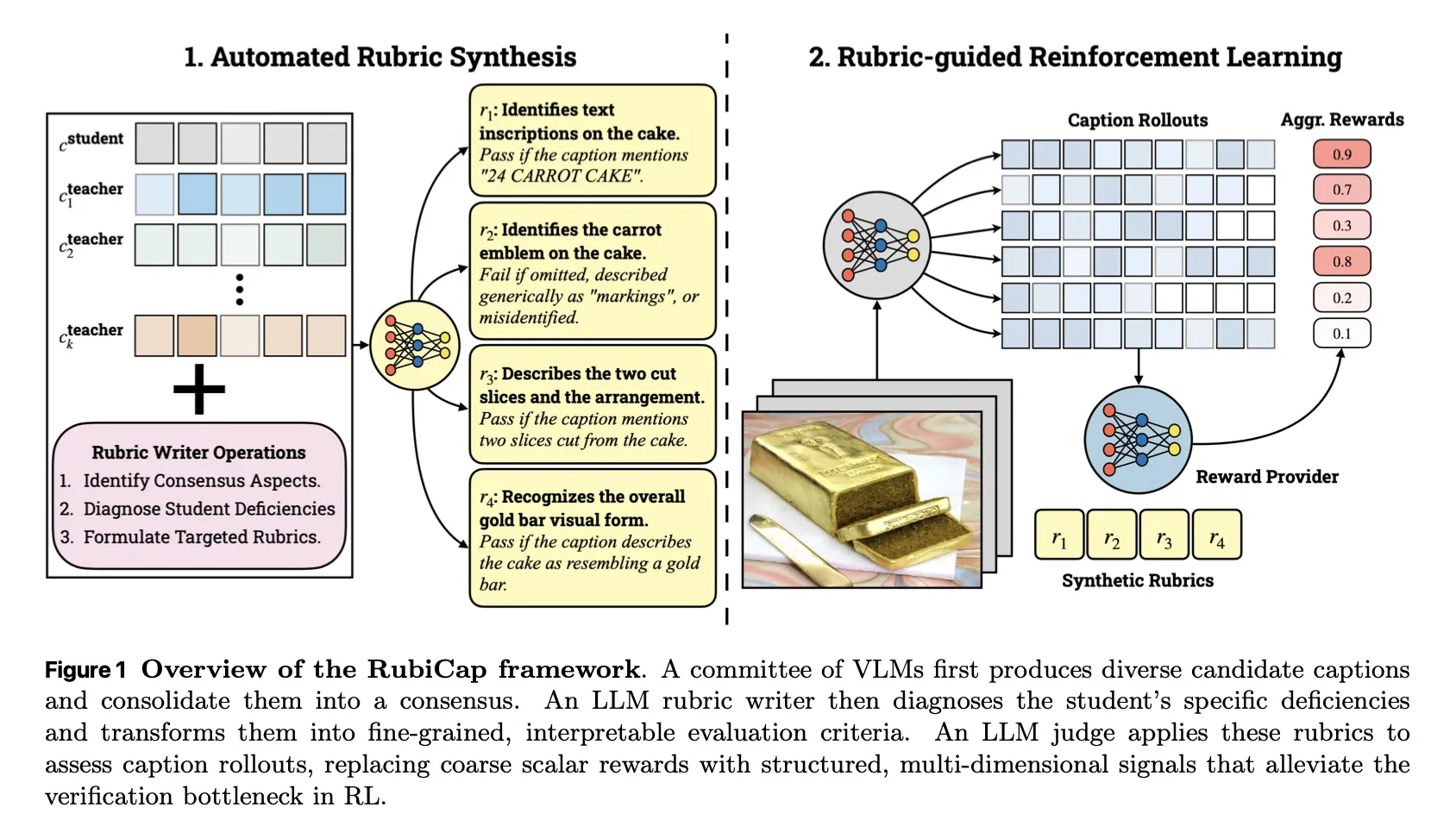

Hlavním problémem současných modelů je, že jejich trénování na expertních datech je extrémně drahé a popisy od jiných AI často postrádají rozmanitost. Apple proto zvolil metodu posilovaného učení (Reinforcement Learning) vedeného rubrikami.

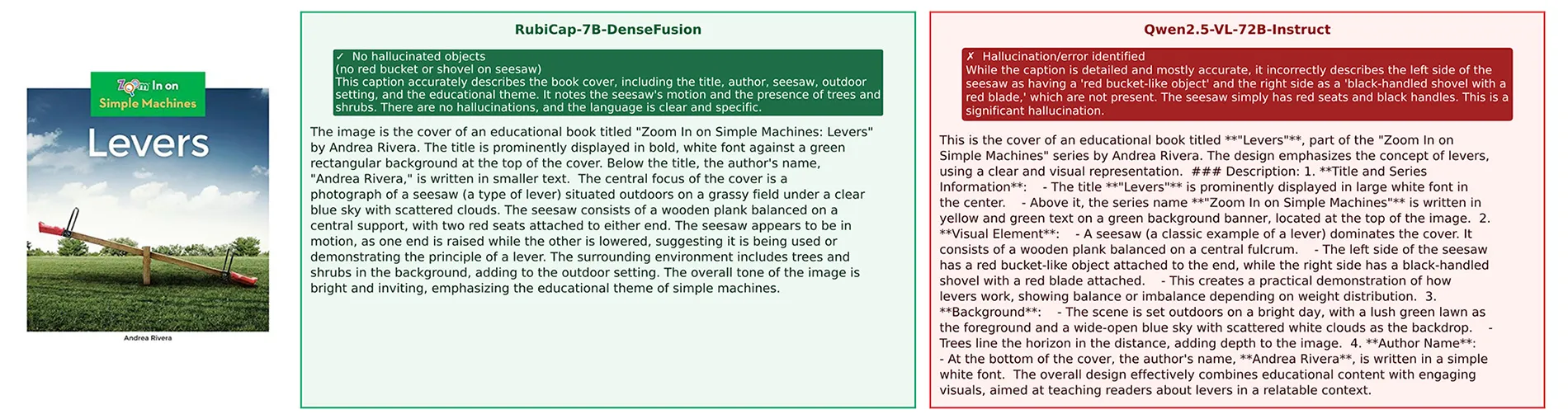

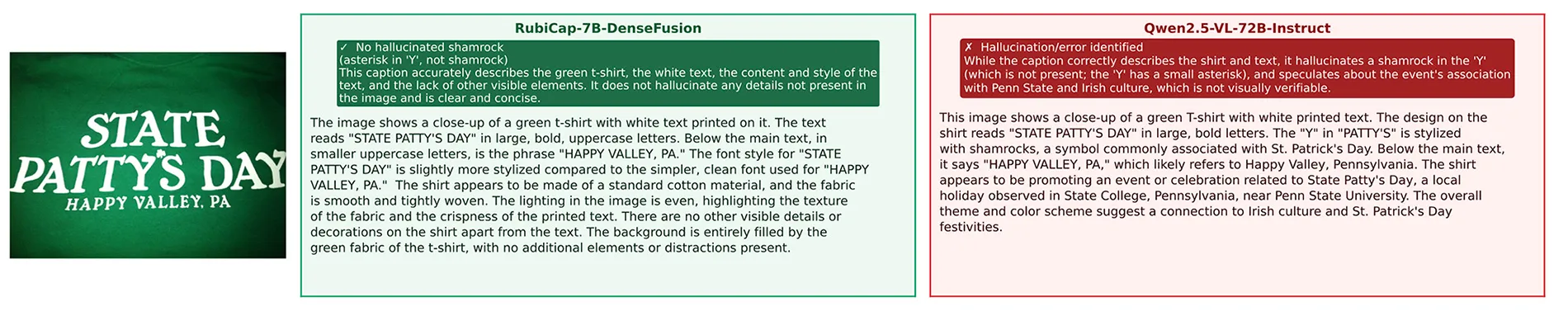

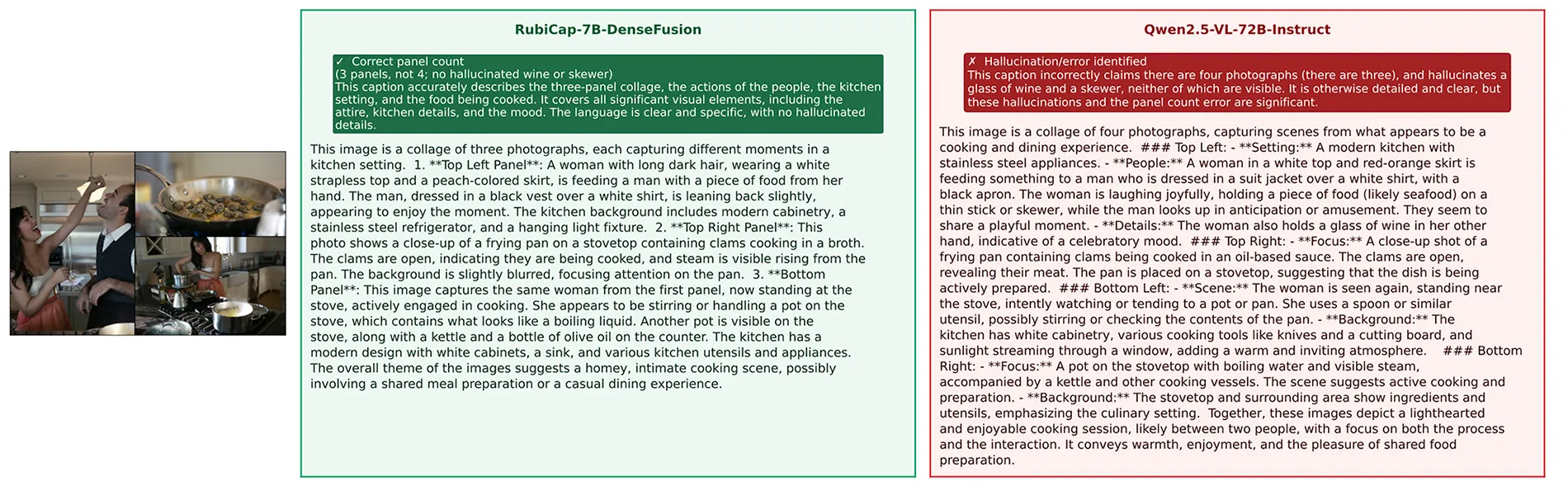

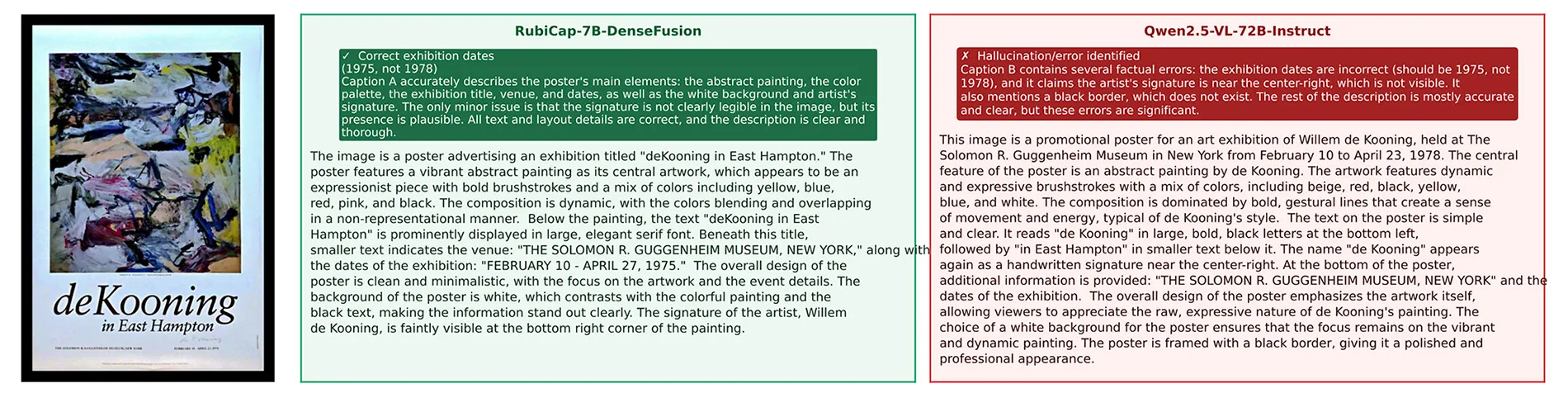

A jak to funguje? Systém vygeneruje několik variant popisů pomocí špičkových modelů jako GPT-5 nebo Gemini a následně je porovná s vlastním výstupem. Inteligentní „rozhodčí“ (v tomto případě model Qwen) pak tyto pokusy boduje podle přesných kritérií, což modelu poskytuje strukturovanou zpětnou vazbu, co přesně opravit.

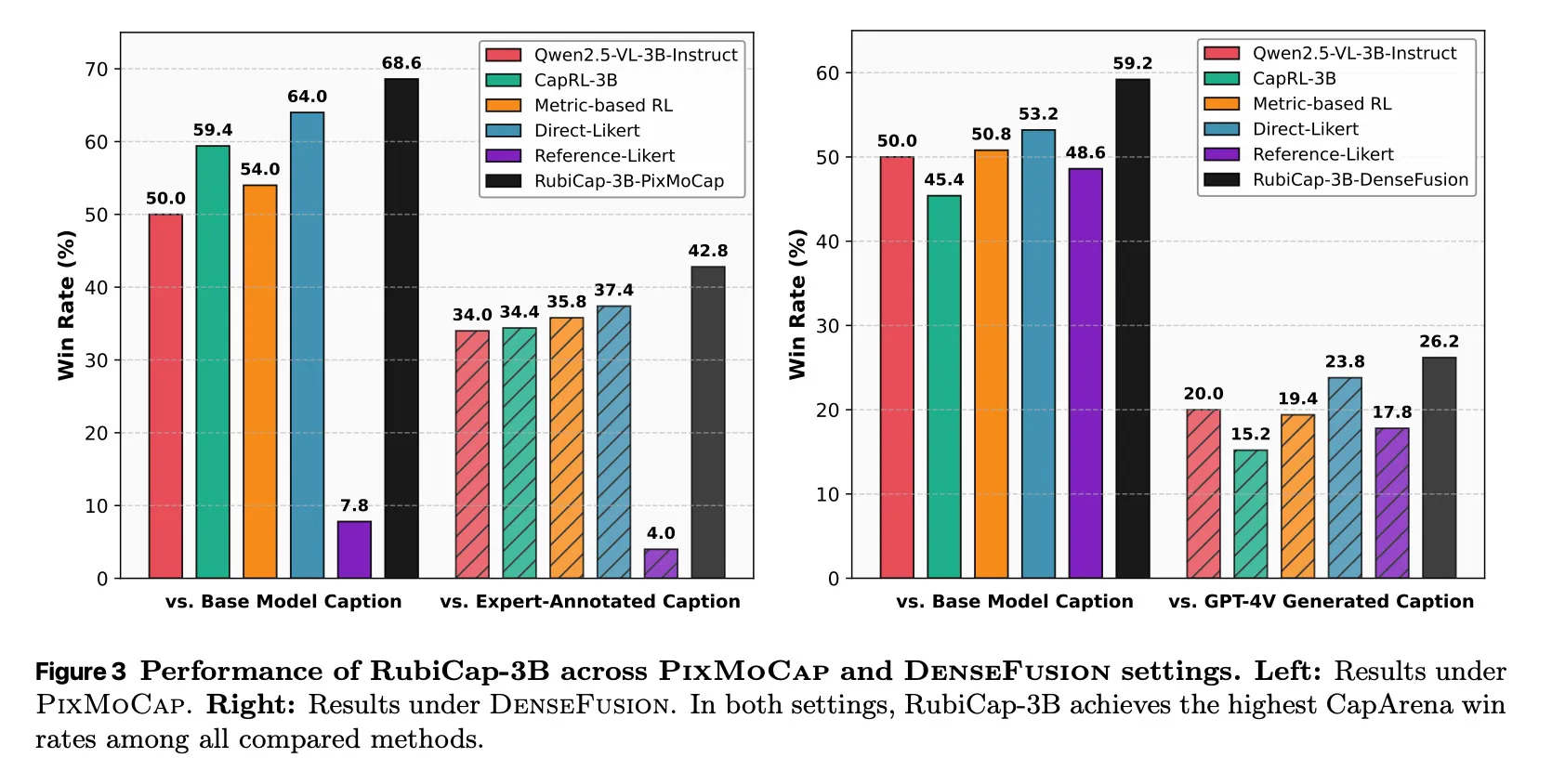

Výsledky jsou překvapivé. Výzkumníci vytvořili tři varianty modelů. A sice RubiCap-2B, 3B a 7B (podle počtu miliard parametrů). I ten nejmenší z nich dokázal v testech porazit modely s až 72 miliardami parametrů. Ukázalo se, že RubiCap-7B dosahuje nejvyšší přesnosti a nejnižší míry halucinací (vymýšlení si neexistujících detailů) ze všech testovaných řešení.

Studie ukázala ale zajímavý paradox. Model RubiCap-3B v některých benchmarcích překonal svého většího 7B sourozence. To naznačuje, že pro kvalitní a detailní popisování obrázků není nutné stavět monstrózní modely, pokud je tréninkový proces dostatečně promyšlený. Podle vědců dokonce modely trénované na popisech z kompaktního RubiCap-3B vykazovaly lepší výsledky než ty, které se učily z dat od uzavřených placených modelů. Za mě jde o velmi zajímavý výzkum a jsem zvědavý, jak to Apple promítne do svých technologií.