Organizace Tech Transparency Project (TTP) zveřejnila znepokojivou zprávu: na App Store a Google Play je snadno dostupných desítky AI aplikací, které dokážou vytvářet nežádoucí sexualizované obrázky žen. Tyto tzv. „nudify“ aplikace často fungují na principu generativní umělé inteligence a porušují pravidla obou platforem. Zpráva ukazuje, že mnoho těchto aplikací bylo stáhnuto více než 705 milionkrát a dohromady vydělaly přes 117 milionů dolarů. Vzhledem k tomu, že Apple i Google si z těchto příjmů berou provize, nepřímo z této činnosti profitují.

Mohlo by vás zajímat

Jednoduché vyhledání, minimální kontrola

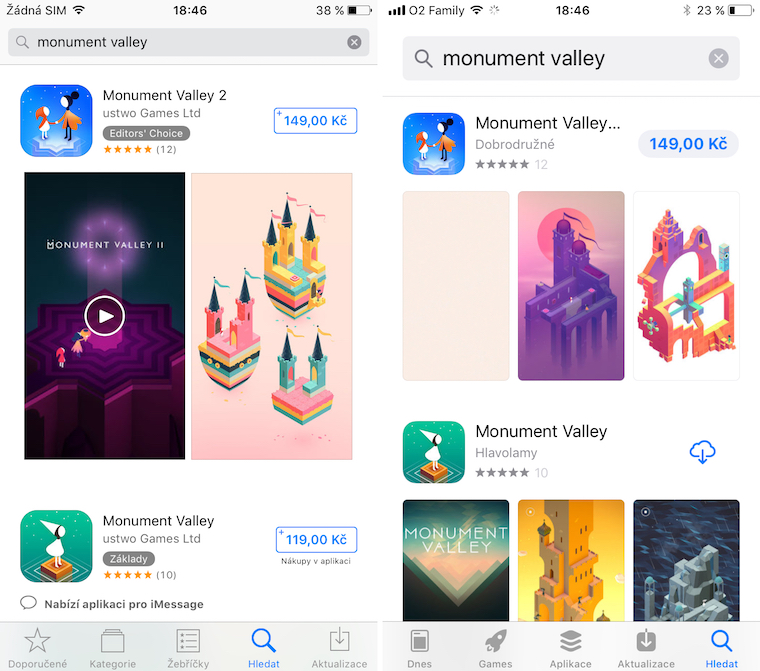

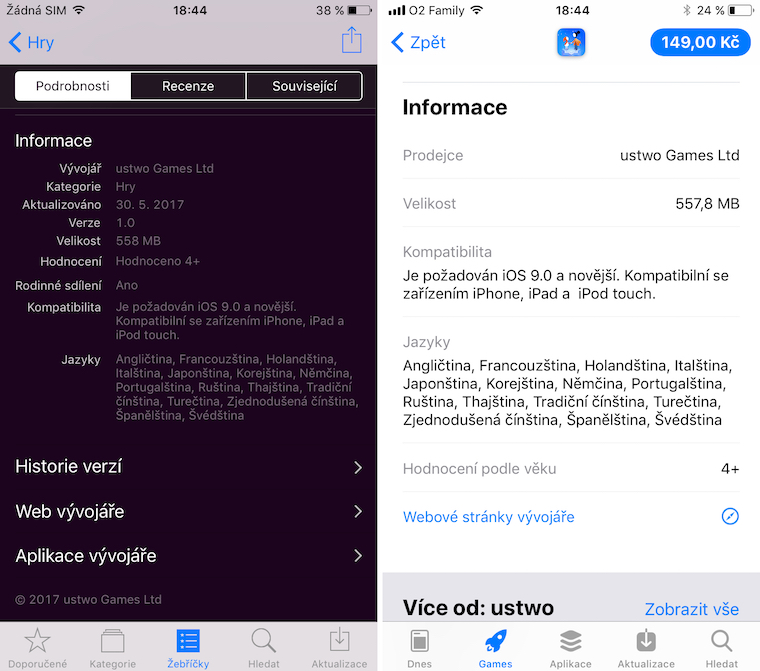

Podle TTP lze tyto aplikace snadno najít pomocí klíčových slov jako nudify nebo undress. Některé dokonce své funkce otevřeně inzerují. Testy provedené TTP ukázaly, že 47 iOS a 55 Android aplikací umožnilo vytvořit nevhodný obsah i ve svých bezplatných verzích – často na základě jednoduchého textového zadání. Apple přitom v minulosti tvrdil, že výběr aplikací přísně kontroluje, a že právě kvůli bezpečnosti si účtuje až 30% provize. Zpráva ale naznačuje, že se v App Store opakovaně objevují aplikace porušující zásady, včetně těch určených pro děti – některé z testovaných měly přístupnost už od 9 let.

Apple i Google čelí kritice

Aplikace často nabízejí šablony jako „tear clothes“, „chest shake dance“ nebo „bend over“, které jsou jasně sexualizované. TTP tvrdí, že Apple ani Google nedokážou dostatečně vymáhat vlastní pravidla a ponechávají platformám prostor pro zneužívání AI k vytváření neetického obsahu. Zpráva tak znovu otevírá otázku, jaká je skutečná efektivita moderování obsahu ve světě, kde je generativní AI stále dostupnější – a zneužitelnější.

Tak proto trvali na tom ze telefon musi umet sideloading